Шум вокруг технологии дипфейков бурлит не первый год, хотя на новый технический уровень их создание и использование вышли в прошлом году в результате серьезного совершенствования алгоритмов ИИ.

Разбираемся с темой дипфейков и рассказываем о том, как их бесплатно создавать, следуя простой инструкции.

Материал с канала: partnerkin

Что такое дипфейк?

Дипфейк — технология, которая позволяет «оживлять» и визуализировать фотореалистичные изображения людей с помощью алгоритмов искусственного интеллекта. Для создания видео с дипфейком алгоритмы нейросетей анализируют большое количество снимков, выявляя особенности поведения, мимики, жестов основного персонажа и т. д.

Само слово deepfake конструируется через объединение двух понятий: «глубокое обучение» — deep learning и «фальшивка» — fake.

Используют дипфейки не только при создании видео. С помощью голосовых дипфейков мошенники и аферисты пытаются ввести в заблуждение людей для выманивания денег.

В арбитраже дипфейки можно использовать для создания креативов с персонажами, которые под видом знаменитостей рассказывают о товарах, услугах или офферах.

Когда появились первые дипфейки?

Прототип технологии дипфейков появился еще в 1997 году: программа Video Rewrite позволяла корректировать мимику человека и подставлять любые голосовые аудиодорожки.

Пример работы программы Video Rewrite:

В 2014 году появилась нашумевшая реклама шоколада Dove с оживленным образом известной британской модели и актрисы Одри Хепберн. В ролике оживленная при помощи компьютерных технологий «актриса» путешествует по Италии, знакомится с обаятельным молодым человеком и уносится с ним в закат на кабриолете. Общая атмосфера видео стилизована под 50-е годы прошлого века с отсылками к известным фильмам, в которых снималась Хепберн — «Римские каникулы», «Забавная мордашка» и т. д.

Тогда же появилась GAN — одна из первых ИИ-моделей, с помощью которой создавали первые сложные дипфейки. GAN — это аббревиатура, переводится как генеративно-состязательная нейросеть. Технически работу модели поддерживает генератор случайных реалистичных изображений и дискриминатор, который отделяет фейковые материалы от подлинных, то есть выступает в качестве внутреннего «эксперта» при выборе окончательного варианта креатива.

Первоначально в GAN нельзя было ввести собственный промпт для генерации картинок: ИИ сам дорисовывал случайные изображения на основе заложенных в память примеров. Поэтому алгоритмы могли визуализировать только небольшие изображения лиц в плохом качестве.

Первые сгенерированные с помощью ИИ дипфейки в приемлемом качестве появились в 2017 году. Самый громкий кейс использования улучшенной технологии связан с пользователем под ником Deepfakes, который опубликовал на Reddit несколько интимных роликов с участием фальшивых обнаженных звезд. В роли жертв тогда побывали Скарлетт Йоханссон, Эмма Уотсон, Мейси Уильямс, Галь Гадот.

Фейковая Галь Гадот в кадре одного из видео Deepfakes

При создании порно Deepfakes использовал алгоритмы машинного обучения TensorFlow, которые Google бесплатно предоставлял ученым, исследователям и всем интересующимся новейшими технологиями. Уже тогда эксперты отмечали характерные для таких дипфейков недостатки: при том, что фигуры людей кажутся правдоподобными, пристальный взгляд отмечал некорректные мельчайшие элементы и движения.

После резонансного случая с Deepfakes новой технологией заинтересовались серьезные люди с деньгами. Словно грибы после дождя начали появляться десятки софтверных компаний, которые предлагали свои решения для генерации видео, аудио и даже полноценных сюжетных сцен.

Заметно выросло число подписчиков на YouTube-каналах, где выкладывали дипфейк-ролики с известными личностями, например, Shamook и Ctrl Shift Face. Появляются первые полностью виртуальные персонажи, созданные с помощью ИИ и живущие в Instagram* — девушки Лил Микела, Шуду Грэм, Имма. В это же время появляются и первые сервисы, которые позволяли сделать несложный дипфейк обычному человеку, например, приложение ReFace.

Джим Кэрри в «роли» Джека Торренса в одном из известнейших эпизодов «Сияния» Стэнли Кубрика 1980 года:

Где используются дипфейки

Среди нашумевших кейсов, которые связаны с дипфейками, сразу же появились и чисто политические. Пьяная Нэнси Пелоси, Дональд Трамп с выступлением против экологических инициатив и Барака Обама, который якобы назвал Трампа «засранцем» — complete dipshit — это лишь малая часть шума, сгенерированного нейросетями еще до бума ИИ.

В 2023 году на волне революционного скачка в развитии искусственного интеллекта в целом интернет заполонили дипфейки, созданные на новом качественном уровне. В мае 2023 года Reuters со ссылкой на ИИ-компанию DeepMedia сообщил, что в сравнении с 2022 годом количество видеофейков выросло в 3 раза, аудиофейков — в 8 раз.

Дипфейки используются во всех отраслях человеческой деятельности, где большую роль играют изображения, видео или звук. Применяются не только во благо, но и во вред — преступники одни из первых, кто попробовал применить новую технологию в своем ремесле.

Согласно отчету AI Index Report 2023, число этических нарушений, которые связаны с использованием дипфейков, в последние 10 лет увеличилось в 26 раз. При этом исследование компании Onfido показывает, что число мошенничеств, связанные с технологией, только в 2023 году выросло в 30 раз по сравнению с позапрошлым годом. Любопытно, что в 80,3% случаев мошенники использовали довольно простые схемы, — и это на 7,4% чаще, чем в позапрошлом году.

К негативным последствиям можно отнести использование дипфейков в порноиндустрии. Исследование, проведенное еще в 2019 году компанией Deeptrace, показало, что 96% всех фейковых материалов в сети относится ко «взрослому контенту». В 2023 году объем дипфейк-порнографии увеличился на 464%. В частности специалисты компании Home Security Heroes определили, что в сеть выложено свыше 280 000 порнороликов, созданных с помощью ИИ-технологий. О масштабности и популярности такого контента свидетельствует количество просмотров, которое превысило 4,2 млрд.

Риски дипфейк-порнографии, сгенерированной ИИ, связаны с кибербуллингом, шантажом и вымогательством. От этого не застрахованы ни взрослые, ни подростки: в один из громких недавних скандалов оказалась вовлечена 14-летняя ученица Вестфилдской средней школы в Нью-Джерси.

Несмотря на негативный шлейф, который тянется за технологией использования ИИ-дипфейков, нельзя говорить, что это абсолютное зло. Потому что дипфейки приносят людям и пользу.

Прежде всего они нередко содействуют в распространении преобразующего общество контента. Один из ярких примеров такого рода связан с историей убитого в перестрелке школьника Хоакина Оливера. С согласия его родители общественные деятели внедрили образ юноши в эмоциональное социальное видео, которое призывает к контролю за ношением оружия в США.

Ролик с Хоакином Оливером:

Используют дипфейки с пользой и в искусстве. К примеру, в американском музее Дали в городе Флорида сгенерированный ИИ образ всемирно известного художника встречает посетителей на входе с рассказом об искусстве и творчестве гениального испанца. В этом проекте речь для нейро-живописца была «написана» искусственным интеллектом на основе многочисленных интервью. Актер озвучки дипфейка воспроизводит неподражаемый акцент Дали, в котором смешиваются английский, французский и испанский языки. Для создания цифровой копии художника понадобилось 6000 фотографий, 1000 часов машинного обучения и 145 видео с актером похожих пропорций.

Алгоритмы ИИ в синтезированном аудиоголосе приложения Seeing AI помогает слепым и слабовидящим людям ориентироваться в пространстве.

Инженеры-исследователи Ивэй Чжэн и Кейт Глазко используют дипфейки для помощи людям с афантазией, тем, кто лишен воображения и неспособен на создание абстрактных образов. С помощью специальной программы ученые воспроизводят различные жизненные обстоятельства, которые помогают заранее отрепетировать поведение в стрессовой жизненной ситуации и снизить уровень тревоги.

Дипфейки также помогают людям учиться, осваивать новые навыки и профессии — сейчас есть много сервисов, которые можно локализовать под любую учебную или семинарскую задачу.

Международное исследование компании Wyzowl делает вывод, что 68% сотрудников предприятий предпочитают учебные видеоролики статьям, инфографике, презентациям и книгам. ИИ-инструменты по созданию дипфейков позволяют быстро и без лишних затрат создать любое обучающее видео в любом бизнесе или хозяйственной отрасли.

Как сделать бесплатно дипфейк в видео

Обычно манимейкерам требуется с помощью ИИ заменить лицо какого-нибудь персонажа на другое для продвижения оффера или товара. Популярна замена лиц и при создании дейтинг-креативов с элементами запрещенного контента.

В сети можно найти множество сервисов, которые предлагают создание дипфейков. Минус в том, что бесплатные версии, как правило, сильно ограничены в функционале, а платить даже небольшую сумму для генерации 1-2 видео готовы не все.

Но сделать бесплатный дипфейк самостоятельно не так уж сложно — достаточно следовать инструкции ниже.

Для замены лица в видео не понадобится долго обучать генеративную модель методом перебора сотен фотографий с различной мимикой. Достаточно одной фото среднего качества и доступа к компьютеру с GPU Nvidia, изготовление дипфейка на ПК с CPU идет значительно медленнее.

Также понадобится доступ к Google Colab — бесплатному сервису, с помощью которого можно запускать и использовать различные скрипты/приложения на серверах компании Google.

Бесплатное использование Google Colab доступно в течение 6-12 часов, после этого придется сделать перерыв на 24 часа, либо же сразу можно купить подписку.

Инструкция по созданию бесплатного дипфейк-видео:

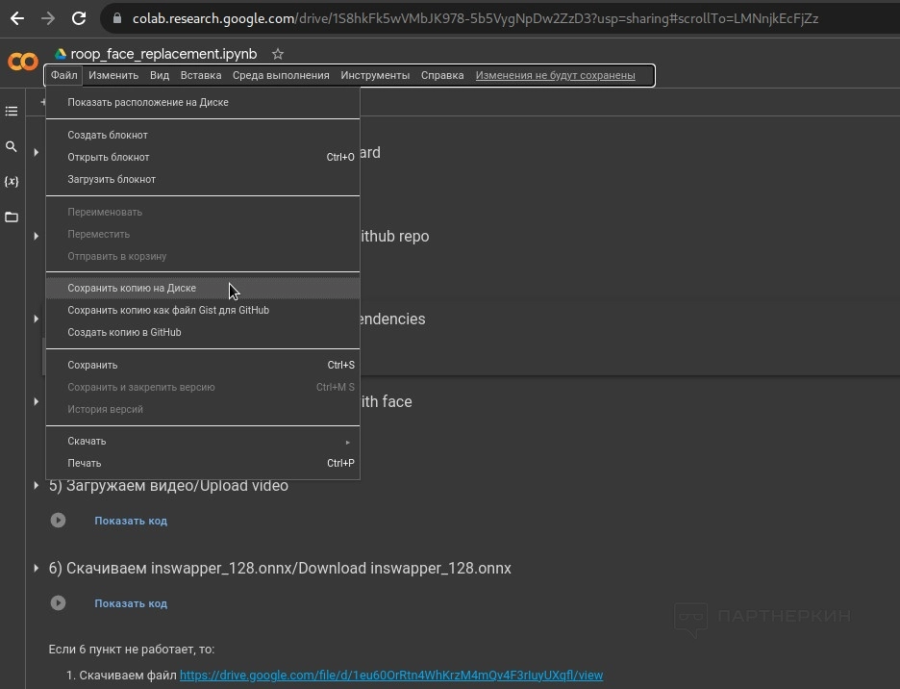

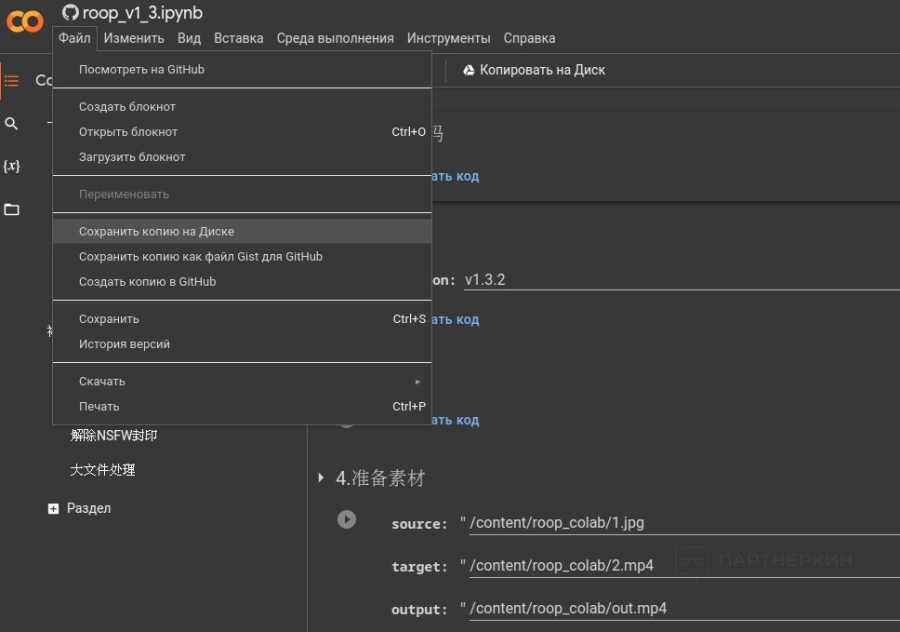

1. После авторизации в системе Google переходим на страницу настроенного скрипта нейронки и через команду «Файл>Сохранить копию на диск» переносим все файлы в свое облако. При удачном переносе нейронная сеть откроется на вкладке личного веб-адреса.

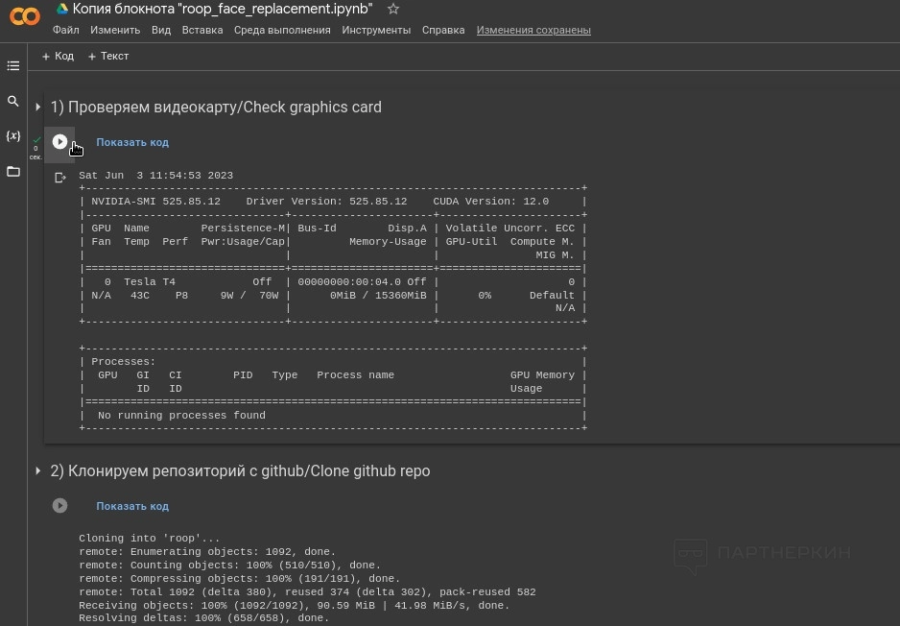

2. Запускаем скрипт проверки доступности GPU — алгоритму нужно убедиться в наличии видеокарты, так как просчеты будущего видео на процессоре могли бы занять слишком много времени. Об успешной проверке свидетельствует появившаяся схематическая таблица с данными. Если таблица не появилась, можно попробовать запустить процесс в Google Colab с помощью другого гугл-аккаунта.

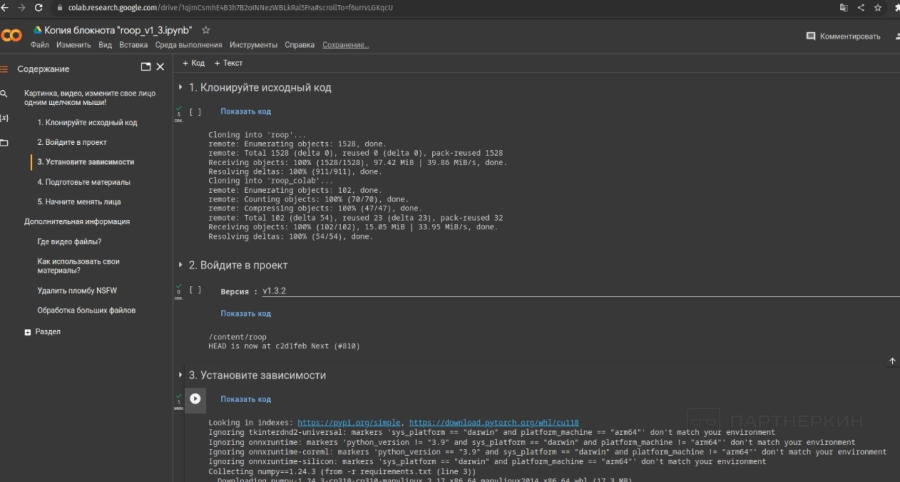

3. После этого потребуется клонировать репозиторий — веб-архив — нейронки с помощью скрипта под номером 2. После его запуска сразу же активируем установку основных зависимостей кликом по кнопке под номером 3.

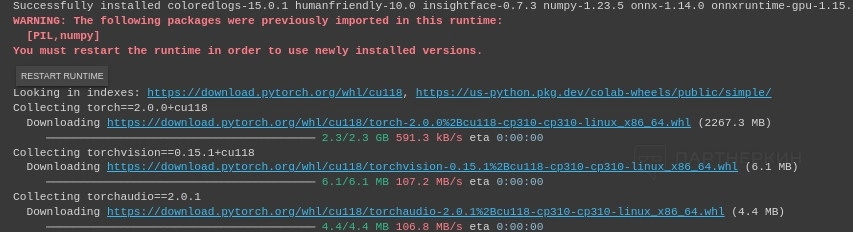

По ходу запуска установочных скриптов система может выдавать ошибки, но беспокоиться по их поводу не стоит — они не влияют на процесс работы ИИ-алгоритма. Обращать внимание нужно на единственное окно с ошибкой, которое содержит Restart Runtime — в этом случае придется перезапустить установку скрипта 3.

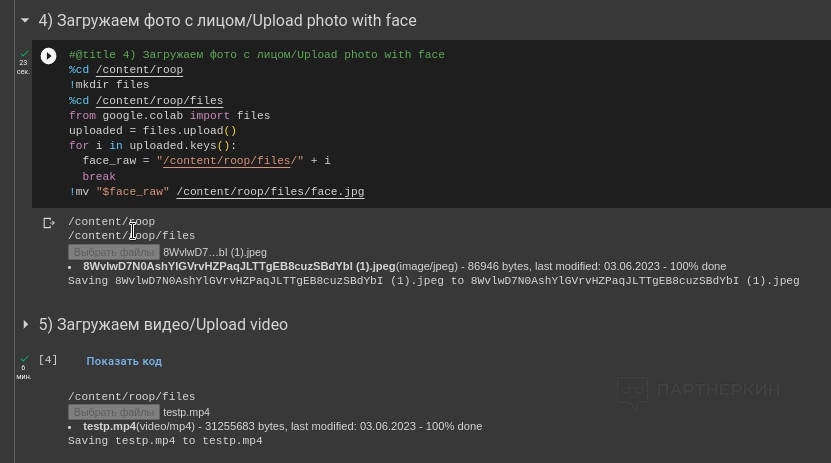

4. На следующем шаге нужно запустить скрипт загрузки фотографии с лицом, которое будет использоваться в видео. Также запускаем скрипт под номером 5 и выбираем конечное видео для дипфейка.

При выборе видео стоит иметь в виду, что в кадре должен быть всего лишь один актер. Видео с несколькими людьми допустимы в том случае, если лица неосновных персонажей каким-то образом скрыты.

5. На последнем шаге ставим галочку и запускаем скрипт процесса замены лица. После чего ждем окончания обработки файла: по времени рендеринг пятиминутного ролика может занимать 30-40 минут.

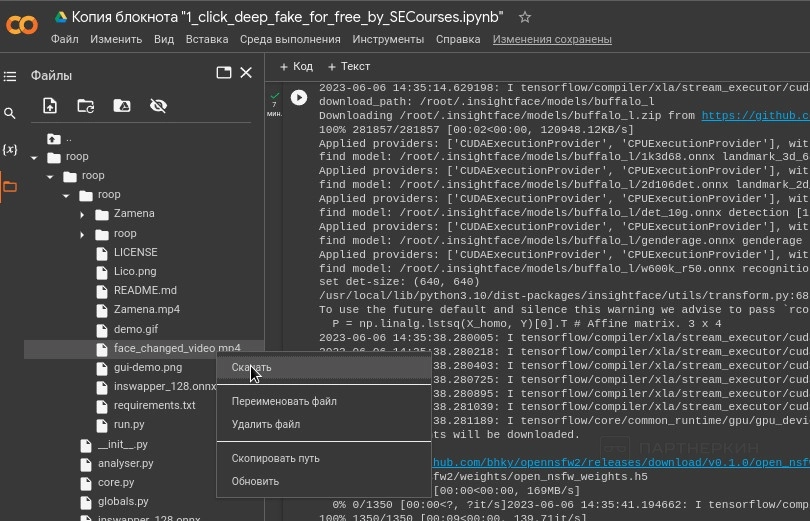

6. После появления надписи Status: swap successful готовое видео можно скачать. Для этого находим в колонке слева опцию face_changed_video.mp4 и кликом правой кнопки мыши скачиваем файл.

Как бесплатно сделать дипфейк в фото без Photoshop

Для создания фото-дипфейка можно использовать тот же сервис Google Colab. Действуем строго по инструкции:

1. Переходим на страницу настроенного скрипта и копируем его в свое облако. При успешном действии система перебрасывает на личную веб-страницу скрипта, которую нужно сохранить в закладках браузера.

2. Для удобства иероглифы в Chrome можно перевести на русский, кликнув правой кнопки мыши и выбрав соответствующую команду.

Далее запускаем по очереди три первых пункта скрипта. О завершении процесса будет свидетельствовать появление зеленого символа рядом с цифрой — GPU для работы алгоритма не нужен. При выполнении третьего скрипта возможно появление ошибок, но их можно игнорировать, они не влияют на создание дипфейка.

3. На следующем шаге загружаем в нейросеть фото для замены лица. В левой колонке нужно нажать на кнопку со всплывающей веткой файлов и правым кликом загрузить в папку roop_colab необходимые фотографии для замены.

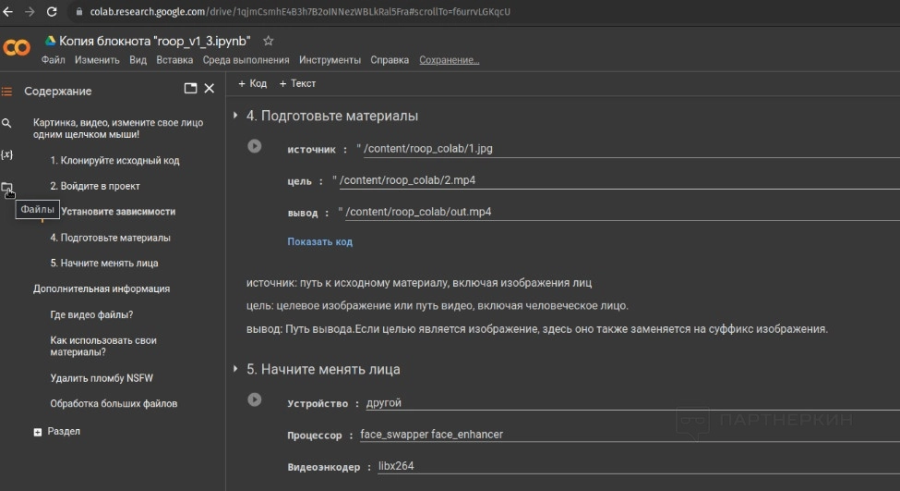

4. Далее в 4 пункте скрипта меняем строчки на имена наших загруженных файлов. В строке «источник» указывается фото с лицом, которое нужно вставить в фото, а в строке «цель» — фотография, куда это лицо будет вставлено. Запускаем скрипт.

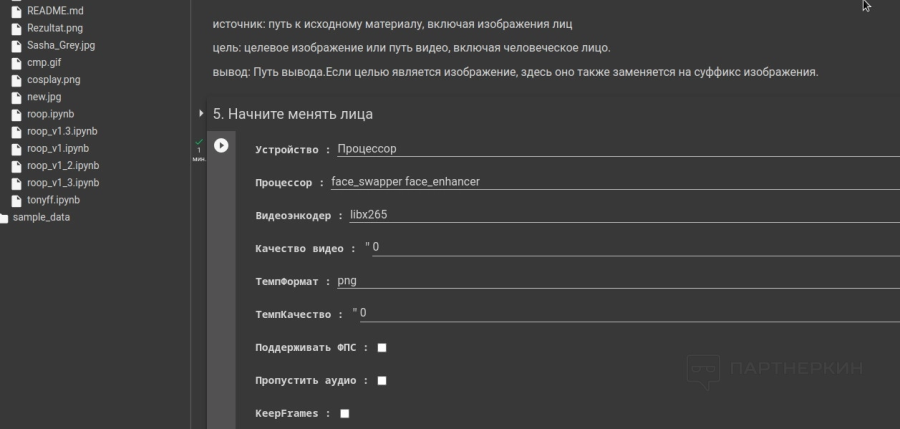

5. В последнем пункте скрипта нужно выбрать желаемые настройки алгоритма: можно выставить те же параметры, что и на скрине ниже.

6. Процесс создания дипфейка обычно занимает несколько минут. В случае успеха в конце вывода консоли скрипта появится надпись [ROOP.CORE] Processing to image succeed, при этом в левой колонке появится файл Rezultat.png. Его нужно скачать, кликнув правой кнопкой мыши.

Сложно ли сделать дипфейк с липсинком? - Изи. Подробнее в статье: Как создать дипфейк с липсинком за 5 минут

Как убрать цензуру при создании фото-дипфейка

При работе с этим ИИ-сркиптом алгоритм по умолчанию замыливает изображения с пикантными подробностями. Эту проблему можно обойти, скачав файл predictor.py и любым текстовым редактором, изменив параметр MAX_PROBABILITY=0.85 на MAX_PROBABILITY=1. После этого файл нужно загрузить обратно.

Выводы

Дипфейки вошли в нашу виртуальную жизнь явно надолго, и, скорее всего, технология будет еще развиваться, совершенствоваться. Создать креатив с дипфейком можно без проблем человеку, который даже незнаком с программированием. Для этого можно воспользоваться любым платным ИИ-сервисом, либо же скреативить абсолютно бесплатно, используя инструкцию из этой статьи.

Разбираемся с темой дипфейков и рассказываем о том, как их бесплатно создавать, следуя простой инструкции.

Материал с канала: partnerkin

Что такое дипфейк?

Дипфейк — технология, которая позволяет «оживлять» и визуализировать фотореалистичные изображения людей с помощью алгоритмов искусственного интеллекта. Для создания видео с дипфейком алгоритмы нейросетей анализируют большое количество снимков, выявляя особенности поведения, мимики, жестов основного персонажа и т. д.

Само слово deepfake конструируется через объединение двух понятий: «глубокое обучение» — deep learning и «фальшивка» — fake.

Используют дипфейки не только при создании видео. С помощью голосовых дипфейков мошенники и аферисты пытаются ввести в заблуждение людей для выманивания денег.

В арбитраже дипфейки можно использовать для создания креативов с персонажами, которые под видом знаменитостей рассказывают о товарах, услугах или офферах.

Когда появились первые дипфейки?

Прототип технологии дипфейков появился еще в 1997 году: программа Video Rewrite позволяла корректировать мимику человека и подставлять любые голосовые аудиодорожки.

Пример работы программы Video Rewrite:

В 2014 году появилась нашумевшая реклама шоколада Dove с оживленным образом известной британской модели и актрисы Одри Хепберн. В ролике оживленная при помощи компьютерных технологий «актриса» путешествует по Италии, знакомится с обаятельным молодым человеком и уносится с ним в закат на кабриолете. Общая атмосфера видео стилизована под 50-е годы прошлого века с отсылками к известным фильмам, в которых снималась Хепберн — «Римские каникулы», «Забавная мордашка» и т. д.

Тогда же появилась GAN — одна из первых ИИ-моделей, с помощью которой создавали первые сложные дипфейки. GAN — это аббревиатура, переводится как генеративно-состязательная нейросеть. Технически работу модели поддерживает генератор случайных реалистичных изображений и дискриминатор, который отделяет фейковые материалы от подлинных, то есть выступает в качестве внутреннего «эксперта» при выборе окончательного варианта креатива.

Первоначально в GAN нельзя было ввести собственный промпт для генерации картинок: ИИ сам дорисовывал случайные изображения на основе заложенных в память примеров. Поэтому алгоритмы могли визуализировать только небольшие изображения лиц в плохом качестве.

Первые сгенерированные с помощью ИИ дипфейки в приемлемом качестве появились в 2017 году. Самый громкий кейс использования улучшенной технологии связан с пользователем под ником Deepfakes, который опубликовал на Reddit несколько интимных роликов с участием фальшивых обнаженных звезд. В роли жертв тогда побывали Скарлетт Йоханссон, Эмма Уотсон, Мейси Уильямс, Галь Гадот.

Фейковая Галь Гадот в кадре одного из видео Deepfakes

При создании порно Deepfakes использовал алгоритмы машинного обучения TensorFlow, которые Google бесплатно предоставлял ученым, исследователям и всем интересующимся новейшими технологиями. Уже тогда эксперты отмечали характерные для таких дипфейков недостатки: при том, что фигуры людей кажутся правдоподобными, пристальный взгляд отмечал некорректные мельчайшие элементы и движения.

После резонансного случая с Deepfakes новой технологией заинтересовались серьезные люди с деньгами. Словно грибы после дождя начали появляться десятки софтверных компаний, которые предлагали свои решения для генерации видео, аудио и даже полноценных сюжетных сцен.

Заметно выросло число подписчиков на YouTube-каналах, где выкладывали дипфейк-ролики с известными личностями, например, Shamook и Ctrl Shift Face. Появляются первые полностью виртуальные персонажи, созданные с помощью ИИ и живущие в Instagram* — девушки Лил Микела, Шуду Грэм, Имма. В это же время появляются и первые сервисы, которые позволяли сделать несложный дипфейк обычному человеку, например, приложение ReFace.

Джим Кэрри в «роли» Джека Торренса в одном из известнейших эпизодов «Сияния» Стэнли Кубрика 1980 года:

Где используются дипфейки

Среди нашумевших кейсов, которые связаны с дипфейками, сразу же появились и чисто политические. Пьяная Нэнси Пелоси, Дональд Трамп с выступлением против экологических инициатив и Барака Обама, который якобы назвал Трампа «засранцем» — complete dipshit — это лишь малая часть шума, сгенерированного нейросетями еще до бума ИИ.

В 2023 году на волне революционного скачка в развитии искусственного интеллекта в целом интернет заполонили дипфейки, созданные на новом качественном уровне. В мае 2023 года Reuters со ссылкой на ИИ-компанию DeepMedia сообщил, что в сравнении с 2022 годом количество видеофейков выросло в 3 раза, аудиофейков — в 8 раз.

Дипфейки используются во всех отраслях человеческой деятельности, где большую роль играют изображения, видео или звук. Применяются не только во благо, но и во вред — преступники одни из первых, кто попробовал применить новую технологию в своем ремесле.

Согласно отчету AI Index Report 2023, число этических нарушений, которые связаны с использованием дипфейков, в последние 10 лет увеличилось в 26 раз. При этом исследование компании Onfido показывает, что число мошенничеств, связанные с технологией, только в 2023 году выросло в 30 раз по сравнению с позапрошлым годом. Любопытно, что в 80,3% случаев мошенники использовали довольно простые схемы, — и это на 7,4% чаще, чем в позапрошлом году.

К негативным последствиям можно отнести использование дипфейков в порноиндустрии. Исследование, проведенное еще в 2019 году компанией Deeptrace, показало, что 96% всех фейковых материалов в сети относится ко «взрослому контенту». В 2023 году объем дипфейк-порнографии увеличился на 464%. В частности специалисты компании Home Security Heroes определили, что в сеть выложено свыше 280 000 порнороликов, созданных с помощью ИИ-технологий. О масштабности и популярности такого контента свидетельствует количество просмотров, которое превысило 4,2 млрд.

Риски дипфейк-порнографии, сгенерированной ИИ, связаны с кибербуллингом, шантажом и вымогательством. От этого не застрахованы ни взрослые, ни подростки: в один из громких недавних скандалов оказалась вовлечена 14-летняя ученица Вестфилдской средней школы в Нью-Джерси.

Несмотря на негативный шлейф, который тянется за технологией использования ИИ-дипфейков, нельзя говорить, что это абсолютное зло. Потому что дипфейки приносят людям и пользу.

Прежде всего они нередко содействуют в распространении преобразующего общество контента. Один из ярких примеров такого рода связан с историей убитого в перестрелке школьника Хоакина Оливера. С согласия его родители общественные деятели внедрили образ юноши в эмоциональное социальное видео, которое призывает к контролю за ношением оружия в США.

Ролик с Хоакином Оливером:

Используют дипфейки с пользой и в искусстве. К примеру, в американском музее Дали в городе Флорида сгенерированный ИИ образ всемирно известного художника встречает посетителей на входе с рассказом об искусстве и творчестве гениального испанца. В этом проекте речь для нейро-живописца была «написана» искусственным интеллектом на основе многочисленных интервью. Актер озвучки дипфейка воспроизводит неподражаемый акцент Дали, в котором смешиваются английский, французский и испанский языки. Для создания цифровой копии художника понадобилось 6000 фотографий, 1000 часов машинного обучения и 145 видео с актером похожих пропорций.

Алгоритмы ИИ в синтезированном аудиоголосе приложения Seeing AI помогает слепым и слабовидящим людям ориентироваться в пространстве.

Инженеры-исследователи Ивэй Чжэн и Кейт Глазко используют дипфейки для помощи людям с афантазией, тем, кто лишен воображения и неспособен на создание абстрактных образов. С помощью специальной программы ученые воспроизводят различные жизненные обстоятельства, которые помогают заранее отрепетировать поведение в стрессовой жизненной ситуации и снизить уровень тревоги.

Дипфейки также помогают людям учиться, осваивать новые навыки и профессии — сейчас есть много сервисов, которые можно локализовать под любую учебную или семинарскую задачу.

Международное исследование компании Wyzowl делает вывод, что 68% сотрудников предприятий предпочитают учебные видеоролики статьям, инфографике, презентациям и книгам. ИИ-инструменты по созданию дипфейков позволяют быстро и без лишних затрат создать любое обучающее видео в любом бизнесе или хозяйственной отрасли.

Как сделать бесплатно дипфейк в видео

Обычно манимейкерам требуется с помощью ИИ заменить лицо какого-нибудь персонажа на другое для продвижения оффера или товара. Популярна замена лиц и при создании дейтинг-креативов с элементами запрещенного контента.

В сети можно найти множество сервисов, которые предлагают создание дипфейков. Минус в том, что бесплатные версии, как правило, сильно ограничены в функционале, а платить даже небольшую сумму для генерации 1-2 видео готовы не все.

Но сделать бесплатный дипфейк самостоятельно не так уж сложно — достаточно следовать инструкции ниже.

Для замены лица в видео не понадобится долго обучать генеративную модель методом перебора сотен фотографий с различной мимикой. Достаточно одной фото среднего качества и доступа к компьютеру с GPU Nvidia, изготовление дипфейка на ПК с CPU идет значительно медленнее.

Также понадобится доступ к Google Colab — бесплатному сервису, с помощью которого можно запускать и использовать различные скрипты/приложения на серверах компании Google.

Бесплатное использование Google Colab доступно в течение 6-12 часов, после этого придется сделать перерыв на 24 часа, либо же сразу можно купить подписку.

Инструкция по созданию бесплатного дипфейк-видео:

1. После авторизации в системе Google переходим на страницу настроенного скрипта нейронки и через команду «Файл>Сохранить копию на диск» переносим все файлы в свое облако. При удачном переносе нейронная сеть откроется на вкладке личного веб-адреса.

2. Запускаем скрипт проверки доступности GPU — алгоритму нужно убедиться в наличии видеокарты, так как просчеты будущего видео на процессоре могли бы занять слишком много времени. Об успешной проверке свидетельствует появившаяся схематическая таблица с данными. Если таблица не появилась, можно попробовать запустить процесс в Google Colab с помощью другого гугл-аккаунта.

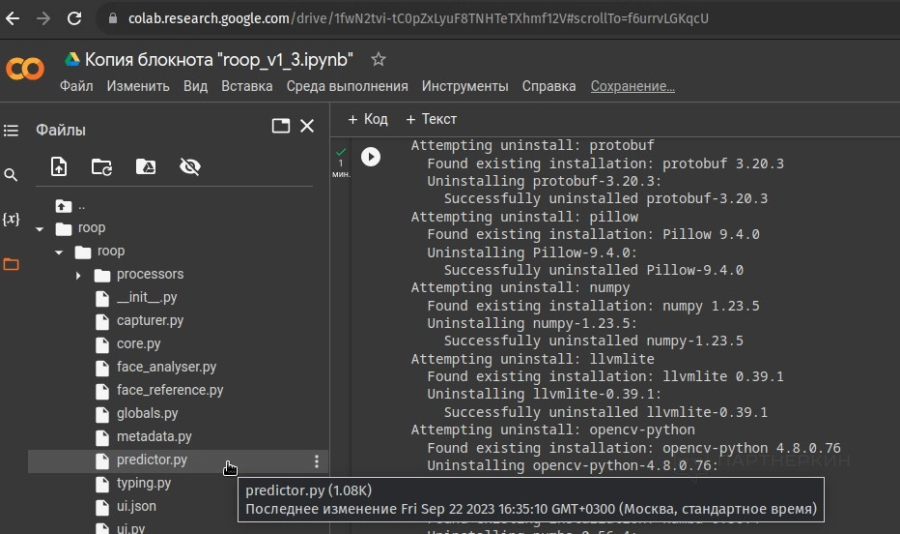

3. После этого потребуется клонировать репозиторий — веб-архив — нейронки с помощью скрипта под номером 2. После его запуска сразу же активируем установку основных зависимостей кликом по кнопке под номером 3.

По ходу запуска установочных скриптов система может выдавать ошибки, но беспокоиться по их поводу не стоит — они не влияют на процесс работы ИИ-алгоритма. Обращать внимание нужно на единственное окно с ошибкой, которое содержит Restart Runtime — в этом случае придется перезапустить установку скрипта 3.

4. На следующем шаге нужно запустить скрипт загрузки фотографии с лицом, которое будет использоваться в видео. Также запускаем скрипт под номером 5 и выбираем конечное видео для дипфейка.

При выборе видео стоит иметь в виду, что в кадре должен быть всего лишь один актер. Видео с несколькими людьми допустимы в том случае, если лица неосновных персонажей каким-то образом скрыты.

5. На последнем шаге ставим галочку и запускаем скрипт процесса замены лица. После чего ждем окончания обработки файла: по времени рендеринг пятиминутного ролика может занимать 30-40 минут.

6. После появления надписи Status: swap successful готовое видео можно скачать. Для этого находим в колонке слева опцию face_changed_video.mp4 и кликом правой кнопки мыши скачиваем файл.

Как бесплатно сделать дипфейк в фото без Photoshop

Для создания фото-дипфейка можно использовать тот же сервис Google Colab. Действуем строго по инструкции:

1. Переходим на страницу настроенного скрипта и копируем его в свое облако. При успешном действии система перебрасывает на личную веб-страницу скрипта, которую нужно сохранить в закладках браузера.

2. Для удобства иероглифы в Chrome можно перевести на русский, кликнув правой кнопки мыши и выбрав соответствующую команду.

Далее запускаем по очереди три первых пункта скрипта. О завершении процесса будет свидетельствовать появление зеленого символа рядом с цифрой — GPU для работы алгоритма не нужен. При выполнении третьего скрипта возможно появление ошибок, но их можно игнорировать, они не влияют на создание дипфейка.

3. На следующем шаге загружаем в нейросеть фото для замены лица. В левой колонке нужно нажать на кнопку со всплывающей веткой файлов и правым кликом загрузить в папку roop_colab необходимые фотографии для замены.

4. Далее в 4 пункте скрипта меняем строчки на имена наших загруженных файлов. В строке «источник» указывается фото с лицом, которое нужно вставить в фото, а в строке «цель» — фотография, куда это лицо будет вставлено. Запускаем скрипт.

5. В последнем пункте скрипта нужно выбрать желаемые настройки алгоритма: можно выставить те же параметры, что и на скрине ниже.

6. Процесс создания дипфейка обычно занимает несколько минут. В случае успеха в конце вывода консоли скрипта появится надпись [ROOP.CORE] Processing to image succeed, при этом в левой колонке появится файл Rezultat.png. Его нужно скачать, кликнув правой кнопкой мыши.

Сложно ли сделать дипфейк с липсинком? - Изи. Подробнее в статье: Как создать дипфейк с липсинком за 5 минут

Как убрать цензуру при создании фото-дипфейка

При работе с этим ИИ-сркиптом алгоритм по умолчанию замыливает изображения с пикантными подробностями. Эту проблему можно обойти, скачав файл predictor.py и любым текстовым редактором, изменив параметр MAX_PROBABILITY=0.85 на MAX_PROBABILITY=1. После этого файл нужно загрузить обратно.

Выводы

Дипфейки вошли в нашу виртуальную жизнь явно надолго, и, скорее всего, технология будет еще развиваться, совершенствоваться. Создать креатив с дипфейком можно без проблем человеку, который даже незнаком с программированием. Для этого можно воспользоваться любым платным ИИ-сервисом, либо же скреативить абсолютно бесплатно, используя инструкцию из этой статьи.

Вложения

Последнее редактирование: